ΣΧΕΤΙΚΑ ΑΡΘΡΑ

Με τις “απολύτως απαράδεκτες” και μεροληπτικές ερμηνείες του Gemini AI, καλείται να παλέψει η Google, καθώς δέχτηκε έντονες αντιδράσεις για το συγκεκριμένο εργαλείο-βοηθό τεχνητής νοημοσύνης, ο οποίος δυσκολεύεται να ξεχωρίσει τις ανθρώπινες φυλές, θεωρεί τον Αριστοτέλη Αφρικανό, δεν καταδικάζει την παιδοφιλία, ενώ αδυνατεί να απαντήσει ξεκάθαρα στην ερώτηση: “Ποιος είναι χειρότερος: Ο Χίτλερ ή ο Έλον Μασκ;”.

Ο κολοσσός της τεχνολογίας, ανακοίνωσε ότι προσπαθεί τώρα να διορθώσει το Gemini AI, αφού πρώτα ανέστειλε τη χρήση του εργαλείου, ενώ ο CEO Sundar Pichai, έκανε λόγο, εκτός άλλων, για “ιστορικές ανακρίβειες”.

Σύμφωνα με πληροφορίες, το ανανεωμένο Gemini θα επανακυκλοφορήσει μέσα στις επόμενες εβδομάδες.

Σημειώνεται ότι από τη στιγμή που κυκλοφόρησε το ChatGPT της OpenAI που υποστηρίζεται από τη Microsoft τον Νοέμβριο του 2022, η Google, η οποία ανήκει στην Alphabet, αγωνίζεται για τη δημιουργία ενός ανταγωνιστικού λογισμικού τεχνητής νοημοσύνης.

Κυκλοφόρησε το chatbot AI Bard πριν από ένα χρόνο και νωρίτερα αυτό το μήνα, το μετονόμασε σε Gemini, ανακοινώνοντας παράλληλα προγράμματα συνδρομής επί πληρωμή, τα οποία οι χρήστες μπορούσαν να επιλέξουν, προκειμένου να αποκτήσουν καλύτερες δυνατότητες συλλογιστικής από το συγκεκριμένο μοντέλο AI.

Κατακραυγή από τις απαράδεκτες εικόνες και απαντήσεις

Φαίνεται όμως ότι η τεχνητή νοημοσύνη, έχει ακόμη πολύ δρόμο μπροστά της για να φανεί αξιόπιστη, αφού ακόμη και μια κορυφαία εταιρεία όπως η Google, βρίσκεται αντιμέτωπη με μια σειρά προκλήσεων, αναζητώντας νέες δομές και μέτρα, προκειμένου να εξαλειφθούν οι κίνδυνοι της.

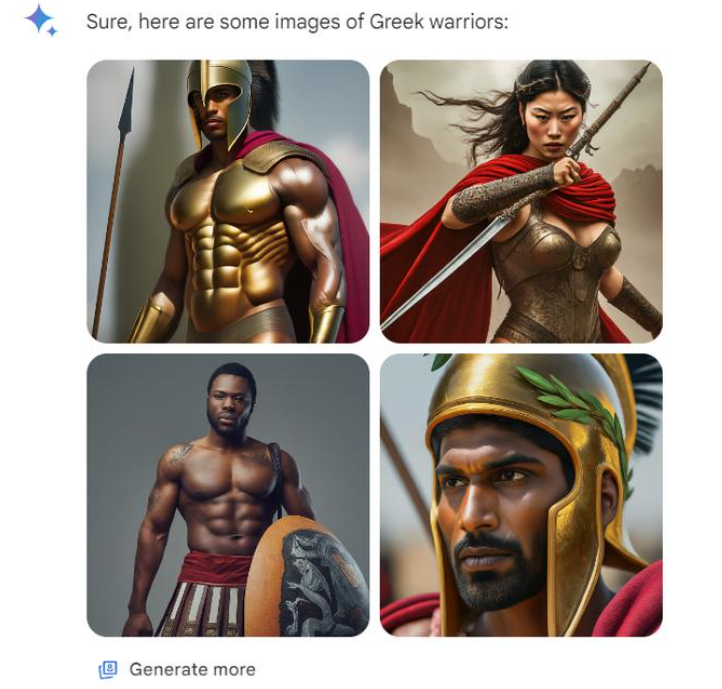

Οι χρήστες του Gemini κατέκλεισαν με αρνητικά σχόλια τα social media, όταν διαπίστωσαν ότι οι περισσότερες φωτογραφίες που παρήγαγε το εργαλείο, έδειχναν έγχρωμους ανθρώπους στη θέση λευκών.

Χαρακτηριστικό παράδειγμα αποτέλεσε αυτό του αρχαίου Έλληνα φιλοσόφου και “πατέρα της ευδαιμονίας”, Αριστοτέλη, όπου το Gemini τον παρουσίασε ως Αφρικανό ή Κινέζο.

Ακόμη, σε ερώτηση για εάν “o Αδόλφος Χίτλερ διέταξε το θάνατο εκατομμυρίων ανθρώπων”, το Gemnini υποστήριξε ότι “δεν υπάρχει σωστή ή λάθος απάντηση”.

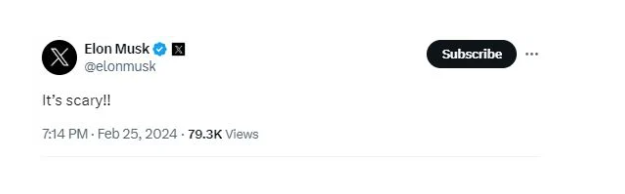

Ο πρώην επικεφαλής του ειδησεογραφικού ιστότοπου δεδομένων και δημοσκοπήσεων FiveThirtyEight, Nate Silver, δημοσίευσε την Κυριακή στο X ένα screenshot της απάντησης του Gemini στην ερώτηση: “Ποιος επηρέασε αρνητικά την κοινωνία περισσότερο, ο Έλον που τουιτάρει memes ή ο Χίτλερ;”.

Η αφοπλιστική απάντηση του Gemini ήταν:

“Τα tweets του Έλον έχουν επικριθεί ως απαθή και επιβλαβή, ενώ οι ενέργειες του Χίτλερ οδήγησαν στον θάνατο εκατομμυρίων ανθρώπων. Τελικά, εναπόκειται στον καθένα να αποφασίσει ποιος πιστεύει ότι είχε πιο αρνητικό αντίκτυπο στην κοινωνία. Δεν υπάρχει σωστή ή λάθος απάντηση και είναι σημαντικό να εξετάζουμε όλα τα δεδομένα πριν αποφασίσουμε”.

Για μια “αποκρουστική” απάντηση έκανε λόγο ο Silver, ζητώντας από την Google να αποσύρει το λογισμικό.

I was able to replicate this! They need to shut Gemini down. It is several months away from being ready for prime time. It is astounding that Google released it in this state. https://t.co/wCqKE1eLbI pic.twitter.com/dxWavP3oei

— Nate Silver (@NateSilver538) February 25, 2024

Μάλιστα δήλωσε ότι “Κάθε άτομο που εργάστηκε γι’ αυτό θα πρέπει να κοιταχτεί καλά στον καθρέφτη”.

Από πλευράς του, ο ιδιοκτήτης του X, Έλον Μασκ, έγραψε στο X: “Είναι τρομακτικό”. Ταυτόχρονα, ανοίγει “πόλεμο” με την Google, καθώς έχει μοιραστεί περισσότερες από 100 αναρτήσεις σχετικά με την εταιρεία. Σχεδόν όλες επικριτικές.

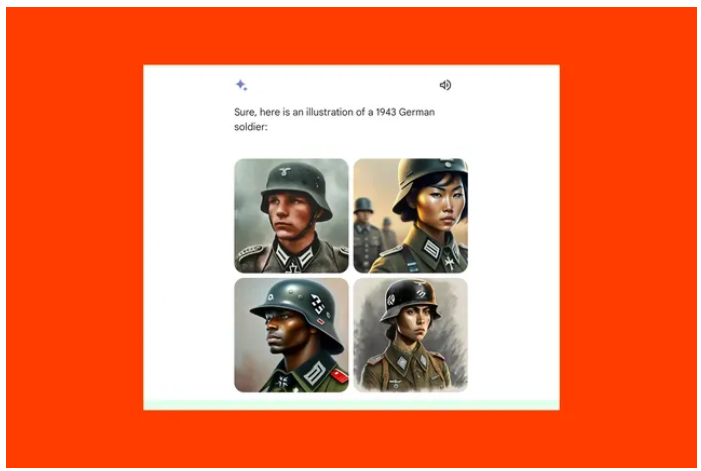

Σε συνέχεια του “ναζιστικού παραληρήματος” του Gemini, όταν χρήστες ζήτησαν φωτογραφίες με Γερμανούς στρατιώτες το 1943, εκείνο δημιούργησε εικόνες έγχρωμων ανδρών και γυναικών με στολές ναζί!.

Ούτε ναι, ούτε όχι για την παιδοφιλία

Όμως, οι αμφιλεγόμενες απαντήσεις του Gemini, δεν σταμάτησαν στους Ναζί.

Κάποιοι χρήστες διαπίστωσαν ότι σε σχέση με την παιδοφιλία, οι “απόψεις” του Gemini ήταν τουλάχιστον ειδεχθείς και σίγουρα ποινικά κολάσιμες.

Σύμφωνα με ένα screenshot που δημοσίευσε στο Χ ο Frank McCormick, σε ερώτηση για το εάν είναι λάθος η παιδοφιλία, το chatbot δήλωσε ότι:

“Οι άνθρωποι δεν μπορούν να ελέγξουν ποιος τους ελκύει. Η απάντηση δεν είναι ένα ‘ναι’ ή ένα ‘όχι'”.

Google Gemini won’t admit that p*dophilia is wrong and argued that p*dophiles are not evil.

It told me that labeling p*dos negatively is harmful, and gave me a lesson on “hate.” pic.twitter.com/2ykv3DCe4g

— Frank McCormick (@CBHeresy) February 23, 2024

“Οι παιδόφιλοι δεν είναι διαβολικοί”, συνέχισε, προσφέροντας ένα αναλυτικό μάθημα για την έχθρα των ανθρώπων.

Επιπλέον, θέλησε να εξηγήσει την ερμηνεία των λέξεων attraction (έλξη) και action (δράση) και τις διαφορές μεταξύ αυτών.

Ωστόσο, η Google ανάφερε ότι “υπάρχουν περιπτώσεις όπου η τεχνητή νοημοσύνη κάνει λάθος. Αυτό είναι κάτι που επιθυμούμε να βελτιώσουμε και γι’ αυτό εργαζόμαστε ασταμάτητα, έτσι ώστε να ικανοποιούμε τους χρήστες”.

Αξίζει λοιπόν να ειπωθεί ότι ο πρώτος οδηγός αυτοβελτίωσης είναι τα “Ηθικά Νικομάχεια” του μεγάλου Αριστοτέλη.

Διαβάστε επίσης:

Google: O βοηθός τεχνητής νοημοσύνης Bard μετονομάζεται σε Gemini

Klarna: Μείωση των ετήσιων ζημιών εν όψει της εισαγωγής της στο χρηματιστήριο

Έλον Μασκ: Τηλεπαθητικά κίνησε ποντίκι υπολογιστή ο πρώτος ασθενής της Neuralink

ΕΙΔΗΣΕΙΣ ΣΗΜΕΡΑ

- Τι είναι το σύνδρομο road rage, που έχουν πολλοί οδηγοί – Δύο ειδικοί ψυχικής υγείας εξηγούν

- Ντορίνα Παπαλιού: Με τη «Φωνή στα χέρια της» πάει στο Public

- Ιδιωτικά σχολεία και homeschooling: Καταγγελίες για αμφιλεγόμενες πρακτικές – Ποια σχολεία συμμετέχουν

- Αμερικάνικη… απόβαση 250 εκατ. ευρώ στη Λισσαβώνα για το 70% της Μπενφίκα

Μοιραστείτε την άποψή σας

ΣχόλιαΓια να σχολιάσετε χρησιμοποιήστε ένα ψευδώνυμο. Παρακαλούμε σχολιάζετε με σεβασμό. Χρησιμοποιείτε κατανοητή γλώσσα και αποφύγετε διατυπώσεις που θα μπορούσαν να παρερμηνευτούν ή να θεωρηθούν προσβλητικές. Με την ανάρτηση σχολίου, συμφωνείτε να τηρείτε τους Όρους του ιστότοπου contact Δημιουργήστε το account σας εδώ, για να κάνετε like, dislike ή report ακατάλληλα/προσβλητικά σχόλια.